El control de la Inteligencia Artificial (IA) por parte de los seres humanos es un tema de creciente importancia en la actualidad. A medida que la IA se ha vuelto omnipresente en diversas áreas de la vida cotidiana y en la industria, surge la necesidad de comprender y abordar cómo podemos asegurarnos de que la IA se utilice de manera ética, segura y beneficiosa para la sociedad.

En este artículo, exploraremos en detalle las dimensiones del control humano sobre la IA, desde la programación y regulación hasta la ética y la educación.

Tipos de Control Humano sobre la IA

Introducción a la Inteligencia Artificial

Para comprender el control humano sobre la IA, primero debemos definir qué es la Inteligencia Artificial. La IA se refiere a la capacidad de las máquinas o sistemas de software para realizar tareas que normalmente requieren inteligencia humana, como el razonamiento, la resolución de problemas, el aprendizaje y la toma de decisiones. Esto se logra mediante algoritmos y modelos matemáticos que permiten a las máquinas procesar datos y realizar tareas específicas de manera autónoma.

Desde su concepción en la década de 1950, la IA ha evolucionado significativamente y ha encontrado aplicaciones en una amplia gama de campos, como la medicina, la educación, la industria automotriz, la atención al cliente y más. La IA se ha convertido en una parte integral de nuestra vida cotidiana, desde asistentes virtuales en teléfonos inteligentes hasta sistemas de recomendación en plataformas de streaming de video.

Control Inicial: Programación y Diseño de la IA

El primer nivel de control humano sobre la IA se encuentra en su programación y diseño inicial. Los seres humanos son responsables de desarrollar los algoritmos y modelos que forman la base de la IA. Esto implica tomar decisiones clave sobre cómo se recopilan y procesan los datos, qué características se consideran relevantes y cómo se entrenan los modelos.

- Selección de datos y características: La elección de los datos de entrenamiento es esencial en el desarrollo de la IA. Los datos deben ser representativos y no sesgados para evitar que la IA reproduzca prejuicios. Además, los ingenieros de IA seleccionan las características o variables que el modelo utilizará para tomar decisiones.

- Entrenamiento del modelo: Los modelos de IA se entrenan utilizando grandes conjuntos de datos. Los humanos supervisan este proceso y ajustan los parámetros para mejorar el rendimiento del modelo. El proceso de entrenamiento es fundamental para que la IA pueda realizar tareas específicas con precisión.

- Programación ética: La ética desempeña un papel importante en el diseño de la IA. Los desarrolladores deben considerar las implicaciones éticas de sus algoritmos, asegurándose de que no discriminen ni causen daño a las personas. La programación ética implica la incorporación de principios como la equidad y la imparcialidad en el diseño de la IA.

Regulación y Política de la IA

Además del control inicial a través de la programación, el control humano sobre la IA se ejerce a través de regulaciones y políticas. A medida que la IA se ha vuelto más omnipresente, los gobiernos y las organizaciones han comenzado a establecer normativas para guiar su desarrollo y uso.

- Regulación gubernamental: Diversos países han promulgado leyes y regulaciones específicas para la IA. Estas regulaciones pueden abordar cuestiones como la privacidad de los datos, la seguridad de la IA en aplicaciones críticas y la responsabilidad en caso de decisiones autónomas perjudiciales.

- Ética y responsabilidad: La ética desempeña un papel importante en la regulación de la IA. Se han propuesto principios éticos para guiar el desarrollo y uso de la IA, como la transparencia, la equidad y la rendición de cuentas. Las organizaciones también están estableciendo comités éticos para supervisar proyectos de IA y asegurarse de que cumplan con estándares éticos.

- Impacto social y económico: La regulación de la IA también aborda su impacto en la sociedad y la economía. Esto incluye consideraciones sobre la pérdida de empleos debido a la automatización, la equidad en el acceso a la IA y la competencia en el mercado.

Transparencia y Explicabilidad de la IA

Otro aspecto importante del control humano sobre la IA es la capacidad de comprender y explicar las decisiones y acciones de los sistemas de IA. La opacidad de la IA puede generar preocupaciones en cuanto a su confiabilidad y seguridad.

- Transparencia de la IA: La transparencia implica que los sistemas de IA deben ser comprensibles para los seres humanos. Esto significa que los desarrolladores deben proporcionar información sobre cómo funciona la IA, qué datos utiliza para tomar decisiones y cómo se llega a esas decisiones.

- Explicabilidad de la IA: La explicabilidad se refiere a la capacidad de la IA para explicar sus acciones y decisiones de una manera comprensible para los humanos. Esto es especialmente importante en aplicaciones críticas como la atención médica y la justicia, donde se requiere una comprensión completa de las decisiones de la IA.

- Interpretación de resultados: Los usuarios de sistemas de IA deben poder interpretar los resultados proporcionados por la IA. Esto implica no solo comprender las decisiones tomadas por la IA, sino también evaluar su calidad y relevancia.

Supervisión y Control Continuo de la IA

El control humano sobre la IA no se detiene en su desarrollo y despliegue inicial; también implica la supervisión y el control continuo de su funcionamiento. Esto es esencial para garantizar que la IA cumpla con los objetivos deseados y para corregir cualquier problema que pueda surgir.

- Monitoreo de desempeño: Los sistemas de IA deben ser monitoreados constantemente para evaluar su desempeño. Esto implica recopilar datos sobre su funcionamiento en tiempo real y compararlos con los estándares establecidos.

- Ajustes y mejoras: A medida que se recopila más información y se identifican áreas de mejora, los sistemas de IA pueden ser ajustados y mejorados. Los desarrolladores pueden actualizar algoritmos y modelos para adaptarse a cambios en el entorno o para mejorar la precisión.

- Identificación y mitigación de sesgos: La supervisión continua es crucial para identificar y mitigar los sesgos en la IA. Los sesgos pueden surgir de los datos de entrenamiento o de las decisiones tomadas por la IA. La corrección de sesgos es un aspecto clave del control humano sobre la IA.

Conclusión

En conclusión, el control humano sobre la IA es un proceso multifacético que abarca desde la programación y el diseño inicial hasta la regulación, la transparencia y la supervisión continua. A medida que la IA sigue avanzando, es esencial que los seres humanos mantengan un control riguroso para asegurar que la tecnología beneficie a la sociedad de manera ética y segura.

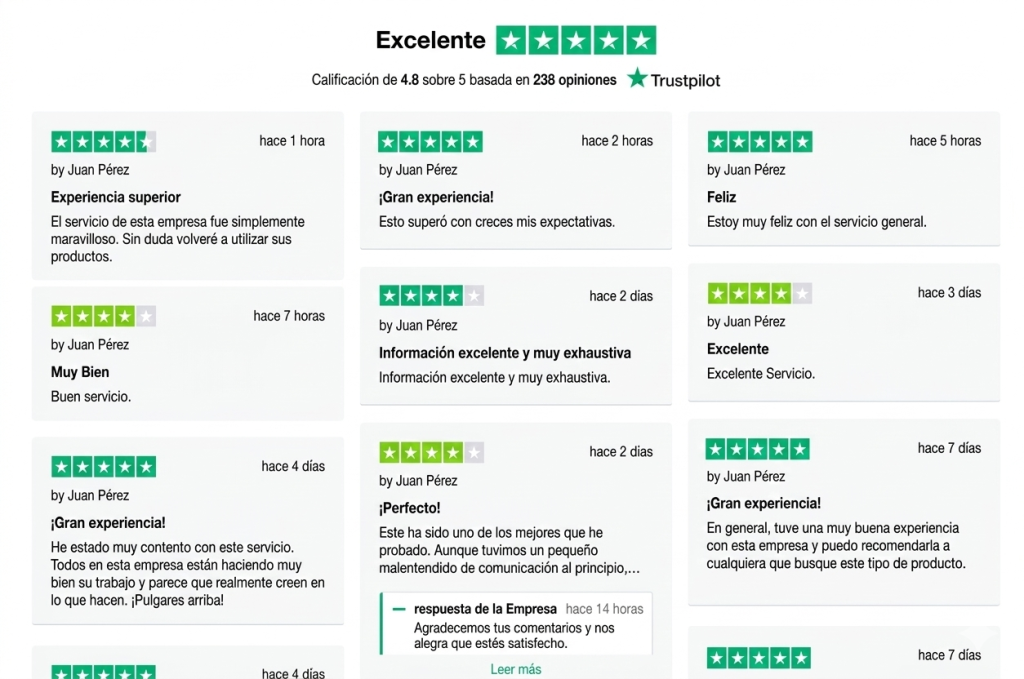

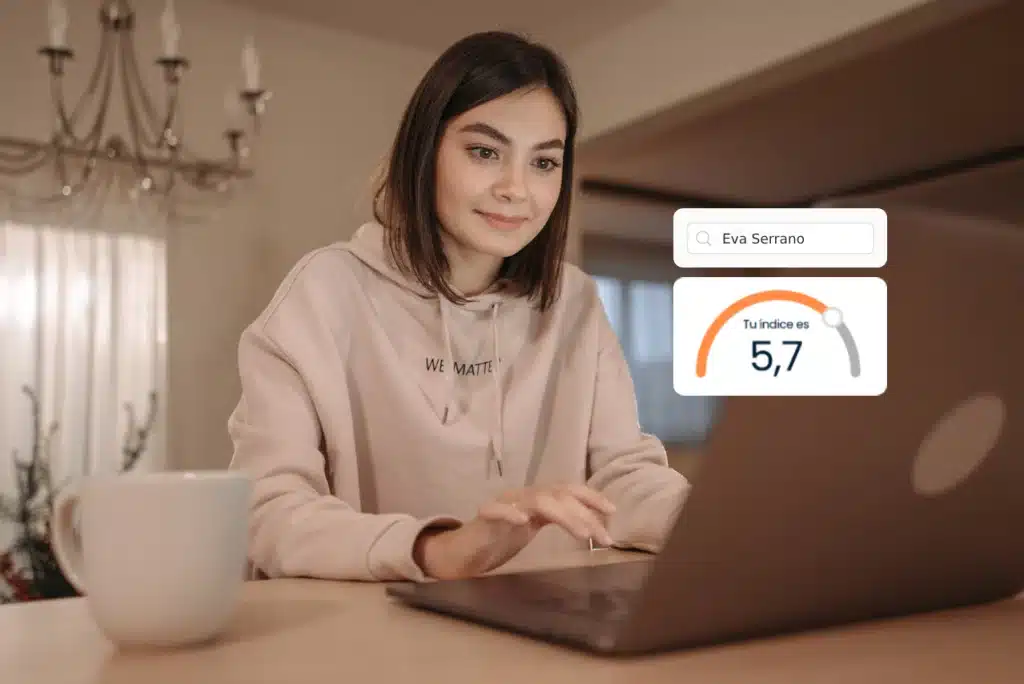

Fotos, vídeos, reseñas negativas o noticias falsas pueden dañar tu imagen. Te ayudamos a eliminarlos o desindexarlos. Déjanos tus datos y te contactamos.

Fotos, vídeos, reseñas negativas o noticias falsas pueden dañar tu imagen. Te ayudamos a eliminarlos o desindexarlos. Déjanos tus datos y te contactamos.